*Ana Henríquez, de la Universidad de las Américas (Chile), dictó la conferencia virtual “Buenas prácticas docentes utilizando IA”, como parte de las Jornadas Académicas 2026 de la Universidad de Colima

Mucho se habla ahora del uso y abuso de la Inteligencia Artificial Generativa (IAG) para crear trabajos escolares y tesis e incluso en las mismas empresas e instituciones, para reducir la carga laboral, para diagnósticos médicos y de salud mental, pero ¿qué tanto estas herramientas digitales presentan un riesgo para la formación académica?

Ana Henríquez Orrego, de la Universidad de las Américas (Chile), señaló esta semana en la conferencia virtual “Buenas prácticas docentes utilizando IA”, que existe un amplio debate sobre la posible pérdida cognitiva asociada al uso de la IAG, el impacto físico de estar largos periodos frente a la computadora, la ampliación de las brechas tecnológicas y los esfuerzos por desarrollar sistemas para detectar su uso en los trabajos de los estudiantes. Sin embargo, resaltó, “es fundamental abordar también aquello que, como docentes, sí nos permite potenciar el pensamiento crítico en la era de la inteligencia artificial, entendida ésta como una forma de colaboración”.

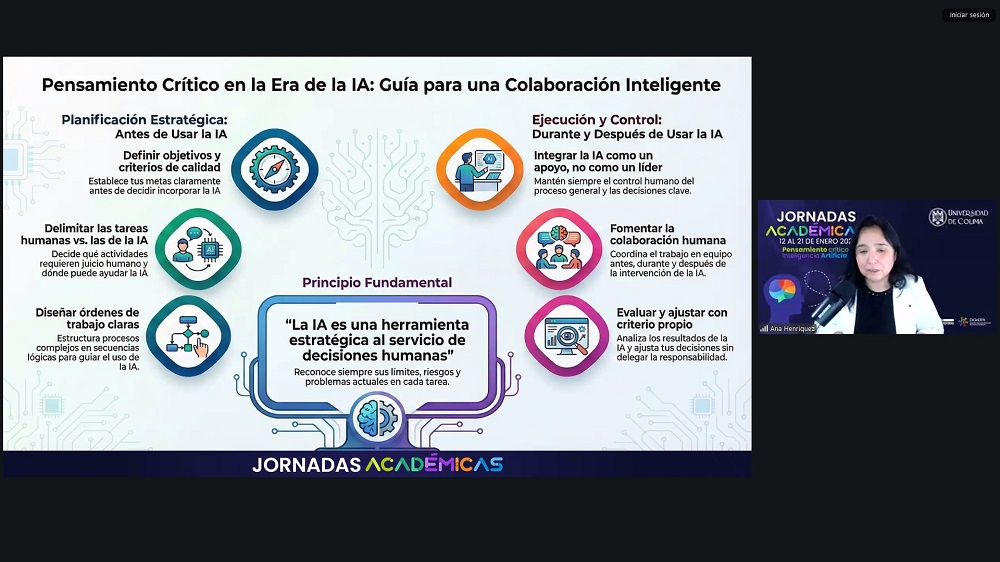

Para esta investigadora es importante que, incluso antes de interactuar con cualquier sistema de inteligencia artificial, se entienda que lo más relevante es la toma de decisiones; es decir, para qué se va a usar, cuáles son los límites, cuándo interactuar, y no simplemente delegar a ciegas las actividades.

“Debemos pensar -agregó- en el uso estratégico de estas herramientas definiendo objetivos, diseñando órdenes de trabajo, coordinando la colaboración y evaluando resultados. Reconocer también los límites para poder decidir, de manera consciente, la integración de esta IA y hacer los ajustes que correspondan o definitivamente llegar inclusive a determinar que no la vamos a utilizar”.

La IA, comentó, está programada como un asistente para dialogar y desde ahí se tiene que comenzar a trabajar. “Tenemos dos alternativas: la dejamos así o la personalizamos. Si se opta por la primera, existen más probabilidades de errores, sesgos, privacidad de datos, autoría, de dependencia cognitiva y un largo etcétera. La segunda opción es personalizarla, decirle a qué nos dedicamos, cuáles son nuestras áreas de interés, y comenzar el diálogo para ver cómo responde e ir ajustándola a nuestro propósito”.

La idea, dijo Ana Henríquez, es que los estudiantes dejen de copiar y pegar, “y en eso el rol del docente es fundamental”. Sería contradictorio, comentó, que los docentes utilicen estas herramientas para preparar las clases y prohibir que las usen los y las estudiantes. “Si queremos que nuestros alumnos aprendan a usar la IA, un primer deber en toda institución educativa es que sus docentes aprendan a usarla bien, entendiendo qué es, cómo funciona, sus errores y posibilidades”.

Colaboradores a medida

Para la investigadora, uno de los caminos es lograr que ChatGPT, Gemini, Cloud, Copilot y Grok dejen de ser simples asistentes y se conviertan en tutores de aprendizaje. Los docentes pueden crear dichos asistentes desde las propias aplicaciones. “Pueden colocar tareas propias de la enseñanza aprendizaje, generación de materiales, propuestas didácticas. Podemos personalizarlas de acuerdo con nuestras clases, pero para ello, nuestras instituciones deben capacitarnos sobre los errores que puede tener, sesgos, errores y alucinaciones”.

Algunas instituciones mexicanas, dijo, han desarrollado o contratado a empresas como Google, Microsoft y OpenAI para generar asistentes o herramientas virtuales que complementen el proceso educativo.

Gemini, Cloud y Chat GPT, compartió, se pueden configurar para el tema educativo. En Gemini a eso se le llama “Aprendizaje guiado”; en Cloud, se configura como “Estilo de aprendizaje” y en ChatGPT como “Estudia y aprende”. Esta configuración ayuda para que, cuando el estudiante haga una pregunta o solicitud, la app “no le entregue rápidamente la respuesta, sino que lo vaya orientando y guiando en el aprendizaje de manera escalonada, con el fin de que efectivamente se comporte como un tutor recomendado de integración en el mundo educativo”.

Notebook LM, continuó, es una tecnología desarrollada por Google principalmente para la educación: “Aquí pueden generar el chat a partir de la información cargada. Pueden crear resúmenes, informes, tarjetas didácticas, tablas de contenido, tablas para organizar información, infografías, presentaciones, podcast y videos”.

“En Notebook LM podemos manipular, identificar qué es lo que vamos a generar como producto, cuál es el mensaje. ¿Cómo podemos ir creando este asistente?, llenándolo de contexto, de instrucciones, de conocimiento, decidiendo qué información va a tener, qué sabe, qué debe hacer, qué debe entregar y cómo debe comportarse”, completó.

En el fondo, concluyó, “el dilema de usar la IAG o no, no es prohibir sino hacer sinergia colaborativa; es decir, hablar con la institución, acercarse a las y los expertos en informática, en programación, con los equipos de protección de datos, para considerar cuándo y a través de qué ruta queremos avanzar y a partir de ahí avanzar en instrumentos de educación y evaluación”.

También sugirió que cuando los y las estudiantes usen cualquier herramienta de IAG, coloquen las ligas de referencias que estas plataformas les dieron, pues muchas veces corresponden a “alucinaciones”, es decir, información falsa.

La conferencia completa está en: https://www.youtube.com/@DiGeDPA/videos

Para más información sobre la ponente y los tutores de aprendizajes pueden consultar el canal de YouTube: Ana Henríquez Orrego, YouTube

Total de Visitas 253539220

A partir del Lunes 11 de Abril de 2011

Desarrollada por HMH Sistemas

Template by OS Templates